AI 工具包中的 Prompt 工程

AI 工具包中的 Prompt 生成器简化了 Prompt 工程工作流程。它可以生成入门 Prompt,帮助您在每次运行时迭代和优化,通过 Prompt 链接和结构化输出分解复杂任务,并提供对代码的轻松访问,以便通过 API 无缝集成大型语言模型 (LLM)。

创建、编辑和测试 Prompt

要访问 Prompt 生成器,请使用以下任一选项

- 在 AI 工具包视图中,选择Prompt 生成器

- 从模型目录中的模型卡片中选择在 Prompt 生成器中试用

要在 Prompt 生成器中测试 Prompt,请按照以下步骤操作

-

在模型中,从下拉列表中选择一个模型,或选择浏览模型以从模型目录中添加另一个模型。

-

输入用户 Prompt,并可选择输入系统 Prompt。

用户 Prompt 是您要发送到模型的输入。可选的系统 Prompt 用于提供带有相关上下文的指令,以指导模型响应。

提示如果您不知道如何输入这些 Prompt,您可以以自然语言描述您的项目想法,并让 AI 驱动的功能为您生成 Prompt 以进行实验。

-

选择运行以将 Prompt 发送到所选模型。

-

(可选)选择添加 Prompt以向对话添加更多用户和助手 Prompt,或选择将响应用作助手 Prompt作为您发送到模型的历史记录和上下文,以进一步指导模型的行为。

-

重复上述步骤,通过观察模型响应并更改 Prompt 来迭代您的 Prompt。

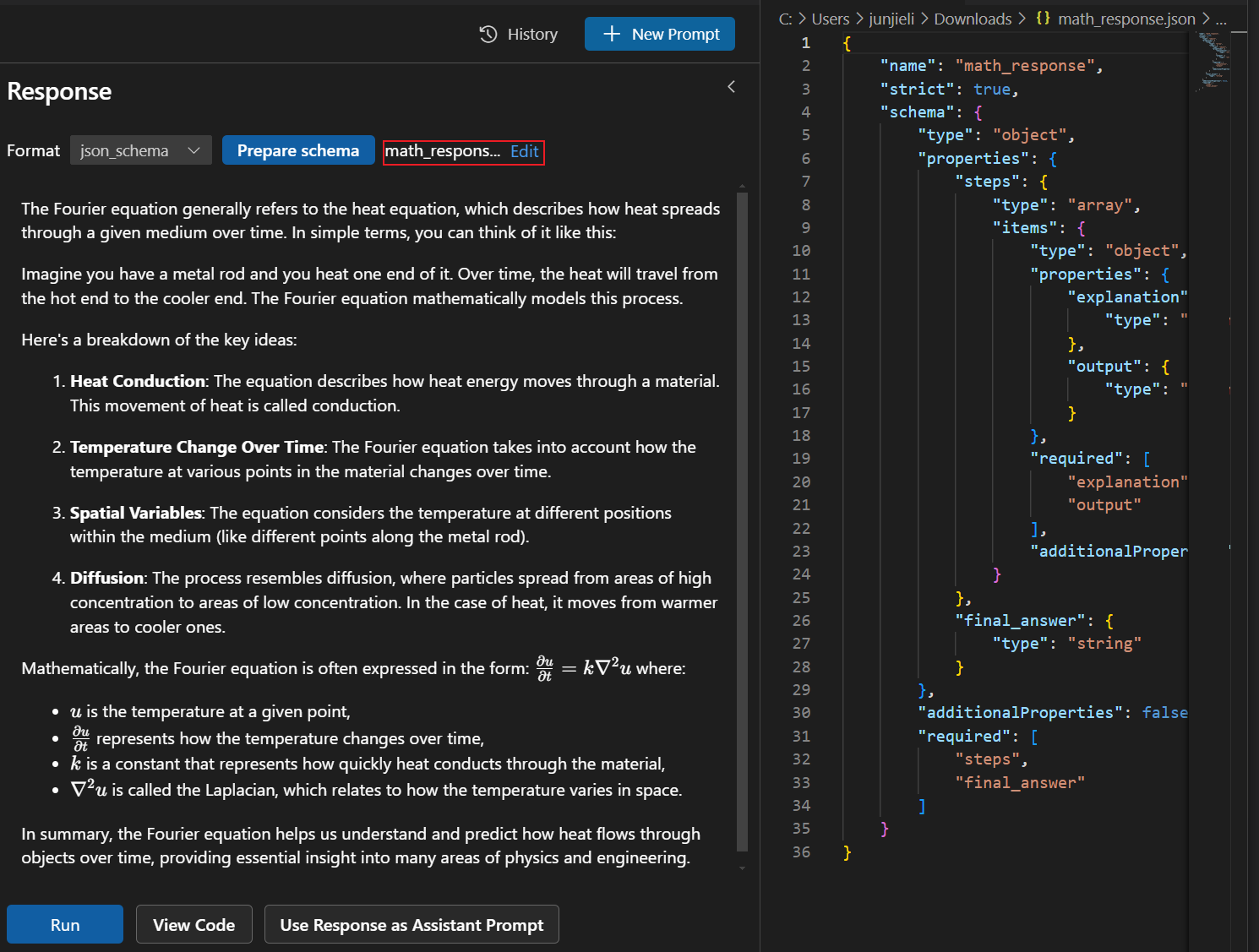

结构化输出

结构化输出支持可帮助您设计 Prompt,以结构化、可预测的格式交付输出。

要在 Prompt 生成器中测试 Prompt,请按照以下步骤操作

-

在响应区域中选择格式下拉列表,然后选择 json_schema。

-

选择准备架构,然后选择选择本地文件以使用您自己的架构,或选择使用示例以使用预定义的架构。

如果您继续使用示例,则可以从下拉列表中选择一个架构。

-

选择运行以将 Prompt 发送到所选模型。

-

您还可以通过选择编辑来编辑架构。

将 Prompt 工程集成到您的应用程序中

在试验模型和 Prompt 后,您可以立即开始使用自动生成的 Python 代码进行编码。

要查看 Python 代码,请按照以下步骤操作

-

选择查看代码。

-

对于 GitHub 上托管的模型,选择您要使用的推理 SDK。

AI 工具包使用提供商的客户端 SDK 为您选择的模型生成代码。对于 GitHub 托管的模型,您可以选择要使用的推理 SDK:Azure AI Inference SDK 或来自模型提供商的 SDK,例如 OpenAI SDK 或 Mistral API。

-

生成的代码片段显示在一个新编辑器中,您可以在其中将其复制到您的应用程序中。

要使用模型进行身份验证,您通常需要来自提供商的 API 密钥。要访问 GitHub 托管的模型,请在您的 GitHub 设置中生成个人访问令牌 (PAT)。